vilamp(video-language model with mixed PRecision)是由蚂蚁集团和中国人民大学共同开发的视觉语言模型,专用于高效处理长视频内容。通过采用混合精度策略,vilamp能够对视频中的关键帧进行高精度分析,显著降低计算成本并提高处理效率。在多个视频理解基准测试中,vilamp表现出色,尤其在长视频理解任务中展现出显著优势。它能够在单张a100 gpu上处理长达1万帧(约3小时)的视频,同时保持稳定的理解准确率,为长视频分析提供了一种新的解决方案。

ViLAMP的主要功能

ViLAMP的主要功能

- 长视频理解:能够处理长达数小时的视频内容。

- 关键信息提取:精确提取视频中的关键信息,并压缩冗余数据。

- 高效计算:在单张A100 GPU上处理长达1万帧(约3小时)的视频,显著降低内存和计算成本,提升处理效率。

- 多任务处理:支持多种视频理解任务,如视频内容问答、动作识别和场景理解等。

ViLAMP的技术原理

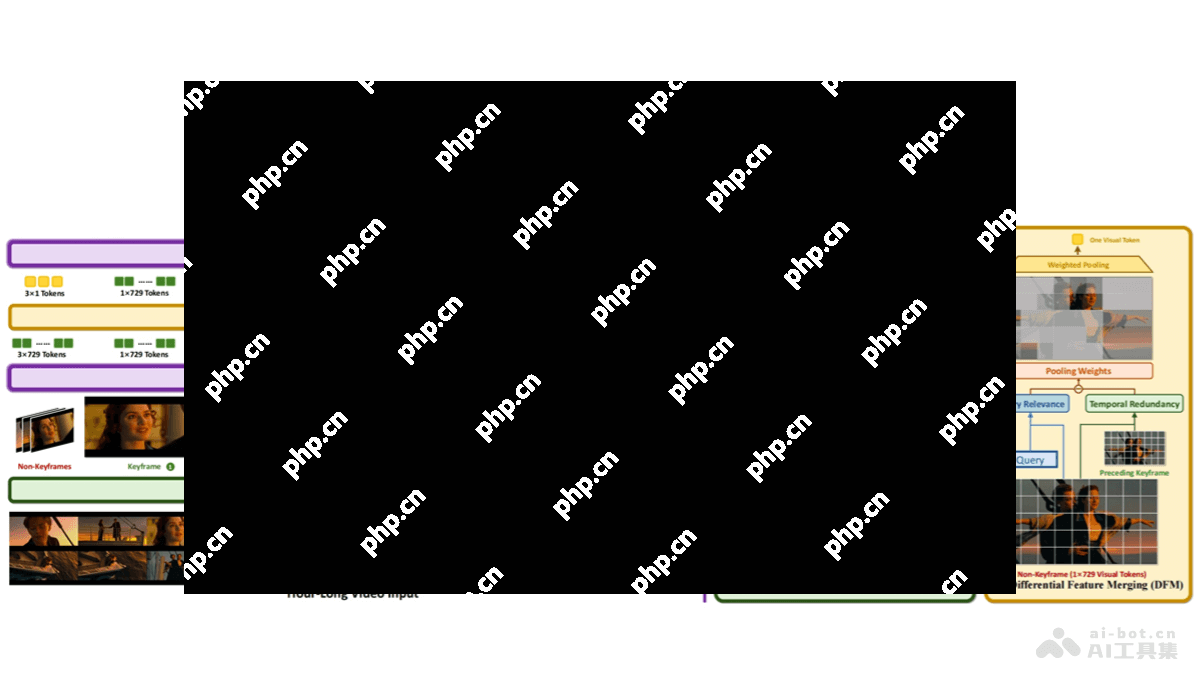

- 差分关键帧选择:利用贪心算法选择与用户查询高度相关且具有时间多样性的关键帧,确保选中的关键帧既能捕捉重要信息,又能避免冗余。

- 差分特征合并:对非关键帧进行压缩,将每个非关键帧的多个PAtch合并为单个token。通过差分加权池化,赋予与用户查询相关且具有独特性的patch更高的权重,同时降低与关键帧重复的patch的权重。这样既保留了关键信息,又显著减少了计算量。

ViLAMP的项目地址

- gitHub仓库:https://www.php.cn/link/feb31e0aF2Ca1ebde5c5c4f73a57fef8

- arXiv技术论文:HTTPS://www.PHP.cn/link/e56a4328794132176d5e33290aef59f2